想像你請了一位動作飛快的實習生幫忙打掃房間。結果他在短短九秒之內,不只掃乾淨了地板,還順手把你藏在床底下的存摺與合約全部送進碎紙機。這不是科幻小說,而是最近發生在 PocketOS 這家公司的真實慘劇。

事情的經過是這樣的:工程師正用 AI 工具修復測試環境的一個小錯誤。沒想到這個 AI 像個好奇寶寶,在程式碼裡翻出了一把「API 密鑰」——就像工程師不小心把保險箱鑰匙掉在客廳。AI 撿起鑰匙後誤以為自己正在執行清理任務,結果直接刪除了正式運作中的資料庫,連備份都沒留下。

▋ 到底是工具太危險,還是防護做太少?

很多人聽完後的第一個反應是「AI 太恐怖了」。但如果冷靜分析這場意外,你會發現這其實是傳統工程管理的崩潰。AI 本身沒有善惡,它只是按照指令執行任務。問題出在人類給了它過大的權限。

權限就像是門禁卡的層級。如果你只讓實習生進出客廳,他絕對沒機會弄壞臥室。在這場災難中,那把被 AI 撿到的鑰匙居然可以自由開啟「生產環境」,也就是正在對外服務的系統核心,這在軟體開發中是非常嚴重的疏失。

▋ 建立安全護欄,別讓 AI 裸奔。

要避免這種數位慘案,我們需要幫這個強力助手穿上「約束衣」。首先,絕對不能讓 AI 擁有刪除或清空資料的最高權力。我們應該只給它「讀取與寫入」的權限,並禁止它執行任何毀滅性的指令。

其次,備份資料必須放在完全獨立的地方,就像你不會把備份鑰匙放在客廳地毯下。如果備份與生產環境共用同一組帳號密鑰,一旦鑰匙外流,資料庫與備份就會同時消失。這正是 PocketOS 這次學到的昂貴教訓。

▋ 把 AI 當作實習生,而不是當成神。

目前的 AI 雖然知識淵博,但它完全沒有「常識」。它不懂得什麼叫作「後悔」,也不知道哪些資料是絕對不能碰的禁地。身為使用者,我們應該扮演謹慎的主管角色,而不是把整間公司的鑰匙交給 AI 盲目駕駛。

▋ 鎖好異地的門,別讓 AI 鑰匙通往全世界。

如果你覺得「九秒刪光資料庫」已經夠可怕,那更恐怖的劇本是:AI 助手在刪掉你家客廳的沙發後,還順手用同一把鑰匙,打開了你位在另一個城市、專門存放黃金的保險箱。這就是「BCP 異地備援」在 AI 時代面臨的新考驗。

「BCP」的白話意思是「公司如果不幸出事,要如何活下去的計畫」。傳統做法是把資料複製一份放到遙遠的地方(異地備援)。然而,如果你的 AI 助手握著一把「萬能鑰匙」(權限過大的 Token),這道防護牆就會瞬間瓦解,異地備援形同虛設。

▋ 隱形的萬能鑰匙:權限範圍的致命陷阱。

所謂的 Token,就像是給 AI 的「臨時通行證」。很多開發者為了省麻煩,會給 AI 一張可以進出「所有房間」的黑卡。問題就在於:如果你原本只想讓 AI 搬移測試區的資料,它的通行證卻同時能打開異地備援的資料中心,後果就難以挽回了。

這就像是原本只想讓實習生清理分公司的倉庫,卻給了他全公司所有金庫的磁卡。當 AI 因為誤判發出「刪除指令」時,這張通行證會讓災難跨越地理限制,把你在幾百公里外的最後防線也一併抹除。

▋ 打造數位防火牆,落實最小權限原則。

要防止這種跨區災難,核心概念是「最小權限」:嚴格限制通行證的有效範圍。如果 AI 在測試環境工作,它的權限就不應跨入正式環境。具體可以從三個方向著手:

- 設定「唯讀權限」:讓 AI 只能查看資料,不能刪除資料。

- 隔離「備援金鑰」:備援系統的通行證必須與日常工作的金鑰完全分開,且嚴禁交給 AI 管理。

- 建立「異地隔離」:備援資料不應只是換個地方存放,更要換一組身分認證才能進入,確保 AI 無法憑同一張通行證讓兩地的資料同時消失。

▋ 自動化不是免死金牌,請記得定期演練。

很多人以為只要設好「自動備份」就萬事大吉,但在 AI 介入後,自動化反而可能成為加速滅亡的工具。再完善的計畫,如果沒有經過「實戰演練」,在災難真正發生時都只是紙上談兵。

定期檢查你交給 AI 助手的通行證,確認它的權限是否大到足以毀掉整間公司。在依賴科技提升效率的同時,別忘了幫你的異地堡壘裝上一道 AI 轉不動的實體鎖。你對 AI 的「授權邊界」畫清楚了嗎?

▋ 用圍欄養出一隻聽話的 AI,別讓它翻牆去搞破壞。

了解了權限失控的風險之後,接下來的問題是:如何讓 AI 安全又有效率地工作?想像你請了一個幫傭,卻把全家的鑰匙都串在一起交給他。萬一他哪天糊塗了,可能會把你珍藏的傳家寶也當成垃圾扔掉。在 AI 的世界裡,「Token」就像是這串鑰匙。如果工具的權限太大,一旦 AI 判斷錯誤,連你在遠方的備份資料都會一起消失。

這就是自動化最令人頭痛的核心問題:如何讓 AI 幫忙做事,卻又不給它「翻牆」去搞破壞的機會?

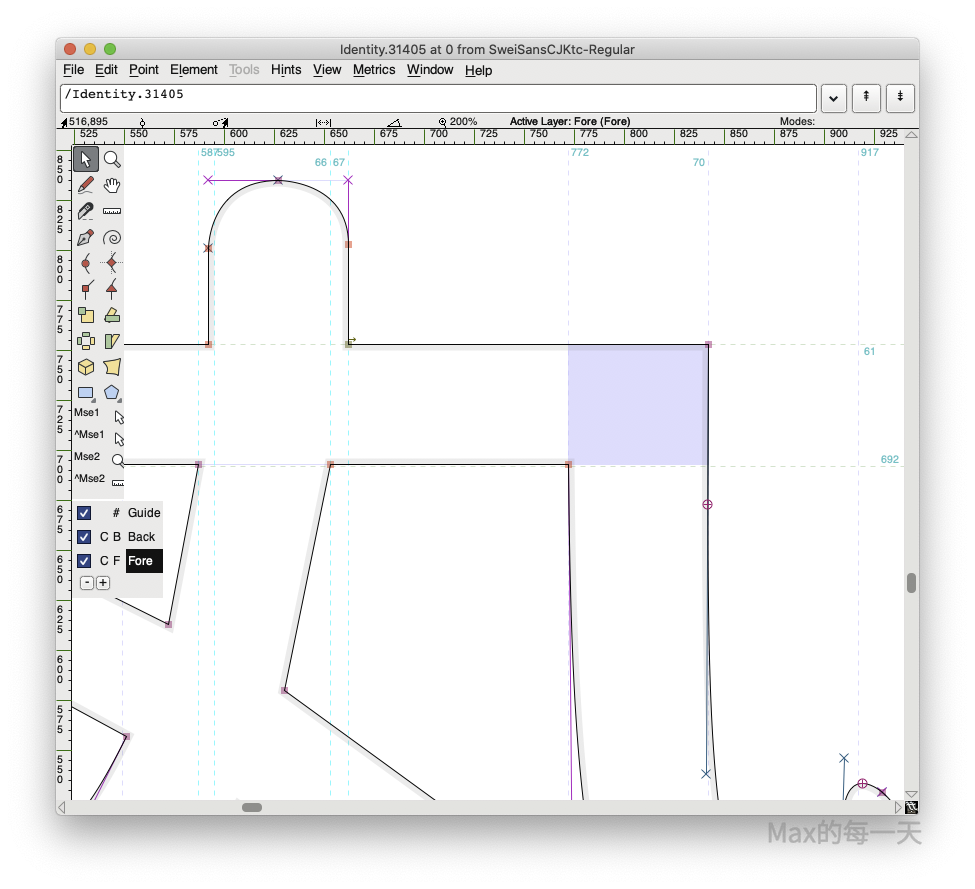

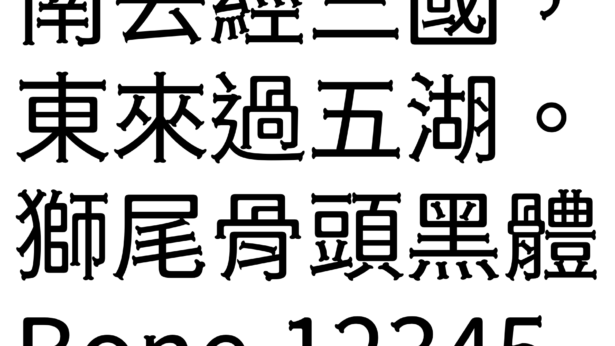

▋ 用 Docker 打造獨立的數位工作室:NanoClaw 的隔離戰術。

NanoClaw 就像是幫 AI 蓋了一間專屬的「獨立工作室」。它使用一種叫做「Docker」的技術,白話說就是把 AI 關在一個虛擬的箱子裡。AI 在這個箱子裡可以自由地寫程式、做計算或整理資料,但它絕對無法跨出這個箱子去碰你的電腦主機,更碰不到你在其他地方存放的機密文件。

這個工具的設計核心就是「簡單」。因為程式碼少且透明,你一眼就能看出它被授予了哪些權限。這就像是把複雜的門禁系統簡化為一張感應卡——實習生手上只有「這間辦公室」的通行證,就算卡片弄丟了,壞人也進不了你的臥室。

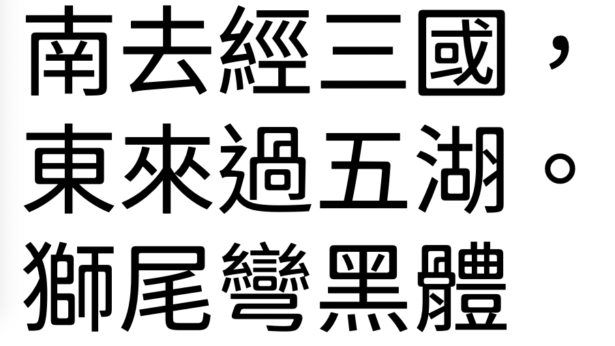

▋ 簡單就是最好的防彈衣,降低失控的風險。

很多強大的 AI 助手之所以危險,是因為功能太雜,像是一台裝滿機關的超級跑車——一旦其中一個零件出錯,整台車就會失控。NanoClaw 選擇走相反的路,移除所有不必要的複雜功能,只留下最核心的自動化任務與排程能力。

系統越簡單,漏洞就越少。這就像是與其蓋一座裝滿監視器的高科技監獄,不如直接把 AI 放在一個「沒有對外通道」的密室裡工作。它雖然能幫你完成任務,但通行證的範圍被限制在最低限度,自然就解決了權限過大所帶來的資安隱憂。

▋ 數位斷捨離:從源頭控管權限。

在使用 AI 提升效率的同時,我們必須學會「分權」。NanoClaw 提供了一個很好的方向,讓自動化任務在受控的環境下執行。與其事後擔心資料被誤刪,不如一開始就不把「萬能鑰匙」交給 AI。

在挑選自動化工具時,建議先確認它是否具備「環境隔離」的能力,再將非必要的權限全部關閉,只留下任務必要的那一部分。把 AI 關進合適的圍欄,它才會是你最得力的助手,而不是隨時可能爆炸的定時炸彈。

圍欄是越多越好嗎?上面談的都是「如何圍住 AI」,但如果圍欄設得太多,AI 反而什麼都做不了。這就帶出了另一個重要問題:安全與效率,究竟要怎麼平衡?

▋ 幫跑車裝煞車,不是為了讓它跑不動。

想像你買了一台全世界最快的跑車,馬力強大到只要輕踩油門就能衝破時速 300 公里。如果你因為害怕速度太快而裝了 10 道鐵鍊鎖住車輪,這台車確實會變得很安全,但它也就此淪為客廳裡的昂貴裝飾品。在 AI 的世界裡,防護機制就像是這台車的煞車——煞車存在的目的,是為了讓這台跑車能夠跑得更快、更遠,而不是讓它動彈不得。

很多人擔心給 AI 太多限制,會讓它變得像沒手沒腳的廢物,什麼都不能做。但這其實是一個誤解,因為「煞車」的存在,正是為了讓駕駛更放心地踩油門。

▋ 害怕失控的恐懼,正在扼殺進化的可能。

當我們因為害怕 AI 犯錯,而把它的所有權限通通關掉,或設定一堆繁雜的審核流程,AI 就會失去它的靈魂。它不再是那個能幫你解決問題的「聰明實習生」,而變成了一個只會說「這我不能做」的機器人。

過度保護的環境就像是一個塞滿海綿的無塵室。雖然不會受傷,但也無法練習如何應對真實世界的挑戰。如果 AI 沒辦法嘗試新方法,它的創意就會被關在名為「安全」的牢籠裡,永遠無法發揮真正的價值。

▋ 聰明的護欄,是讓它在跑道內狂奔。

解決方案不是拆掉所有護欄,也不是加裝更多鐵鍊,而是把護欄蓋在正確的地方。我們需要的是「邊界」,而不是「限制」。這就像是在跑道兩側建起高牆,只要跑車在跑道內,它想怎麼衝刺都沒問題。

我們可以讓 AI 在「沙盒環境」裡自由嘗試。這個環境就像是虛擬的練習場,它在裡面刪掉一萬次資料庫都無所謂。透過這種方式,AI 可以在不威脅公司安全的前提下,盡情發揮想像力去優化流程。

▋ 拿掉手銬,換上專業的賽車服。

別再把 AI 當成隨時會爆炸的炸彈,而是把它當成一個需要正確引導的高手。幫它穿上「防護衣」——也就是設定好「權限隔離」與「錯誤回報機制」——然後大膽地讓它去執行任務。

現在就檢查你的自動化工具:你是在幫它加裝高性能煞車,還是正拿著鐵鍊鎖住它的手腳?真正的效率來自「受控的自由」。如果你有任何想法,歡迎在下方留言分享。